近日,Character AI 與耶魯大學的研究團隊聯合推出了一款名爲 Ovi 的新型音畫同步視頻生成技術。這一開源項目標誌着音頻和視頻生成技術的一次重大突破,打破了以往音畫生成的傳統方式。

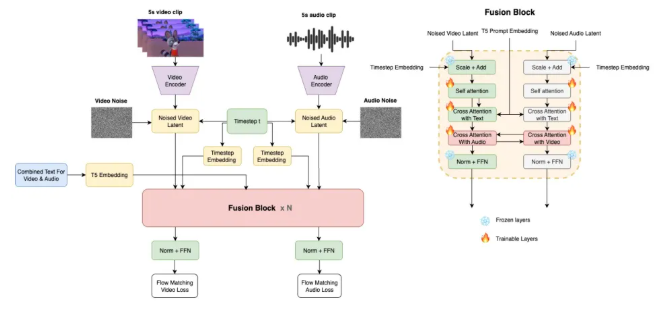

Ovi 採用了一種創新的雙骨幹交叉模態融合架構,將音頻和視頻視爲一個不可分割的整體。在這個系統中,音頻和視頻的處理過程是並行的,彼此之間進行深度交流,從而實現了音畫的完美同步。這一設計理念徹底改變了以往先生成畫面再添加聲音或反之的做法,解決了音畫不同步的問題。

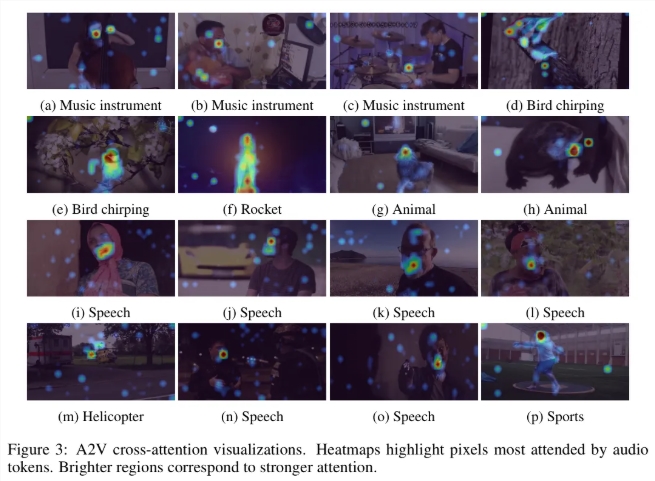

在 Ovi 的架構中,有兩個功能相同的分支,分別負責處理視頻和音頻。這兩個分支採用了相同的擴散變換器架構,使得音頻與視頻在生成過程中能夠直接互動,消除了不必要的參數和計算開銷。這種實時的信息交互使得 Ovi 能夠精準地學習音頻和視頻之間的對應關係,例如嘴脣運動與發音之間的精確匹配。

爲了確保音頻和視頻在時間上的精確對齊,Ovi 引入了一種名爲旋轉位置嵌入的技術。通過數學縮放,音頻和視頻的時間步點實現了完美匹配,確保了在生成過程中二者能夠同步出現。此外,Ovi 在處理用戶輸入時,也使用了統一的文本提示策略,以提高生成效果的準確性和豐富性。

在數據集的構建上,Ovi 團隊設計了複雜的處理流程,確保了訓練數據的多樣性和高質量。他們利用音視頻對的數據集和純音頻數據集相結合的方式,爲模型提供了全面的學習基礎。這種嚴謹的訓練方案爲 Ovi 的成功奠定了堅實的基礎。

github:https://github.com/character-ai/Ovi

劃重點:

🌟 Ovi 是 Character AI 與耶魯大學聯合開發的一款開源音畫同步視頻生成技術。

🎥 採用雙骨幹交叉模態融合架構,實現音頻與視頻的實時互動和完美同步。

📊 團隊構建了高質量、多樣化的數據集,以支持 Ovi 的訓練和應用。