最近、アップル社はApple Silicon向けに開発された機械学習フレームワークMLXが、NVIDIA CUDAのサポートを追加したことを発表しました。このアップデートにより、開発者はApple Silicon搭載MacでMLXを使用してアプリケーションを開発し、CUDA環境にエクスポートして実行することが可能になります。この変化は、アップルが機械学習分野においてまた一つ重要な進展を遂げたことを示しています。

以前は、MLXフレームワークがアップルのMetalプラットフォームと深く統合されていたため、macOSシステム以外では関連操作ができず、開発者たちは通常、デプロイやテストのために追加のハードウェアを購入する必要がありました。新しいCUDAサポートによって、この状況が変わり、開発者はアップル端末で開発およびテストを行い、その後高性能なCUDAハードウェアで本番実行を行うことが可能になります。

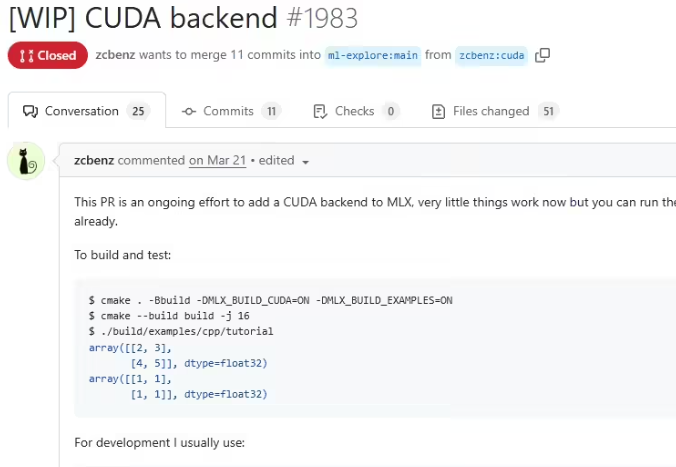

今回のアップデートは、GitHubの開発者@zcbenzによって主導され、数か月前からCUDAサポートのコード構築が始まりました。このプロジェクトはいくつかのモジュールの分割を経て、最終的にアップルのMLXメインブランチに統合されました。注意すべきは、このサポートが、Apple環境に対応したMLXフレームワークからコードをエクスポートすることに限定されているということです。これは、NVIDIAグラフィックカードを搭載したサーバーHW上で実行するためのものです。言い換えれば、Mac Proや外付けGPUドッキングステーションでは、NVIDIAグラフィックカードを直接接続してローカルで機械学習アプリを実行することはできません。開発後、コードの調整とエクスポートが必要です。

この新機能は開発者にとって非常に重要です。NVIDIAハードウェアは非常に高価で、トップグレードのMacの価格の何倍ものコストがかかります。これは、小規模な開発チームがApple Siliconデバイスで開発・テストを行い、量産段階でのみNVIDIAハードウェアを活用すれば、コストを効果的に抑えることができる意味を持ちます。さらに、CUDAシステムではMLXプロジェクトの実行性能が通常Macよりも優れ、NVIDIAハードウェアが機械学習分野で広く使用されていることから、開発者はより強力な計算リソースを手に入れる機会を得ることになります。これにより、アプリケーションのパフォーマンスと効果が向上します。

アップルのMLXフレームワークのこのアップデートは、開発者に多くの柔軟性を提供し、機械学習アプリケーションの開発コストを削減することで、今後さらなる開発者の注目と参加を引き寄せると予想されます。

ポイント:

🌟 アップルのMLXフレームワークはNVIDIA CUDAのサポートを追加し、開発者の柔軟性を高めました。

💰 開発者はApple Siliconデバイスで開発でき、高価なNVIDIAハードウェアへの依存を減らすことができます。

🚀 CUDA環境では性能がマックより優れているため、開発者により強力な計算リソースを提供します。